生成AIって、自分の知らない世界をグッと底上げしてくれる最高の相棒ですよね。でも、ちょっと待ってください。その回答、丸ごと信じてしまっていませんか?AIにはそれぞれ学習の偏り(バイアス)があって、ハルシネーション(もっともらしいウソ)が紛れ込むことも結構あります。人間だって得意不得意があるように、AIだってそうです。

だったら、別のAIにもチェックしてもらえばいいじゃないか——そんな発想から始めた「AIクロスチェック」の実体験をお伝えします!

なぜ「AIクロスチェック」が必要なのか?

生成AIの回答って、学習データの土台によってけっこう変わります。同じ質問を投げても、Google、Anthropic、OpenAI——会社が違えば答えも違う。これ、実際にやってみると本当に面白いんですよね。

考えてみれば、人間の世界でも同じではないでしょうか。お医者さんのセカンドオピニオンが当たり前になったように、AIの出力にも「別の目線からのチェック」があったほうが安心です。

特にセキュリティのような分野では、たったひとつの見落としが命取りになりかねません。だからこそ、学習背景の違うAIに同じドキュメントをぶつけてみることに大きな意味があるんです。

GeminiとClaude、それぞれの個性と使い分け

Google Workspace × Geminiの安心感

Google WorkspaceのGeminiは、入力データがモデルの学習に使われない設計なので、仕事では基本的にGeminiしか使っていませんでした。日常の壁打ち相手としては非常に優秀で、デフォルトで寄り添ってくれるような回答スタイルも心地いいんですよね。

Claudeは……キレッキレです

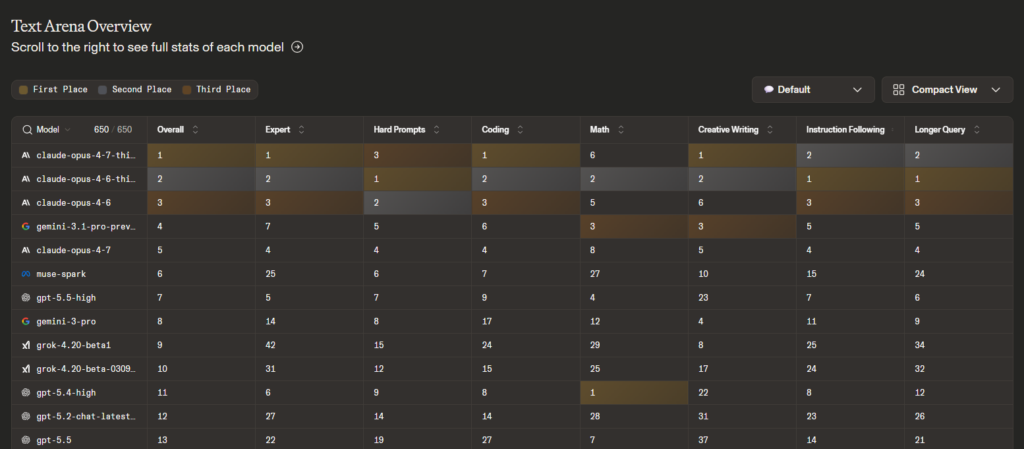

一方、Anthropic社のClaude。AIのブラインドテストサイト「Arena AI(旧:Chatbot Arena / LMアリーナ)」では、かつてはGeminiが上位を占めていましたが、現在はClaudeが各リーダーボードで上位を独占しています。特にコーディング領域ではClaude Opus 4.7 Thinkingが、他のモデルを大きく引き離しました。

ロングクエリや複雑なお題への対応力は、頭ひとつ二つ飛び抜けている印象です。ただし、その分だけ回答の切れ味がすごい。Geminiの優しさに慣れた身としては、そのギャップに思わずたじろぎます……。

(Claudeの個人設定に『ユーモアも交えて、少し温かみが欲しい』とすぐに付け足しました……泣)

実際の使い分けはこんな感じです

Claudeは課金していてもすぐ使用上限がきてしまうのが悩みどころ。そこで、以下のように使い分けています。

- 日常使い → Gemini 3.1 Pro(Google Workspace Businessスタンダード以上のGeminiはたっぷり使えて業務に最適)

- まとめたもののセカンドオピニオン → Claude Opus 4.7(ここぞという場面で切れ味を活かす)

実践!セキュリティ仕様書をClaudeに見てもらった結果

元々、当事務所のセキュリティ対策はGeminiと壁打ちしながらブラッシュアップし、複数のドキュメントにまとめていました。でも、ひとつのAIだけで作ったものには、どうしてもそのAI特有の「死角」が残るんですよね。

そこで、Claudeを新たに契約しました!もちろん学習しないモードに設定して、安全なAIとして利用できる環境を整えています。

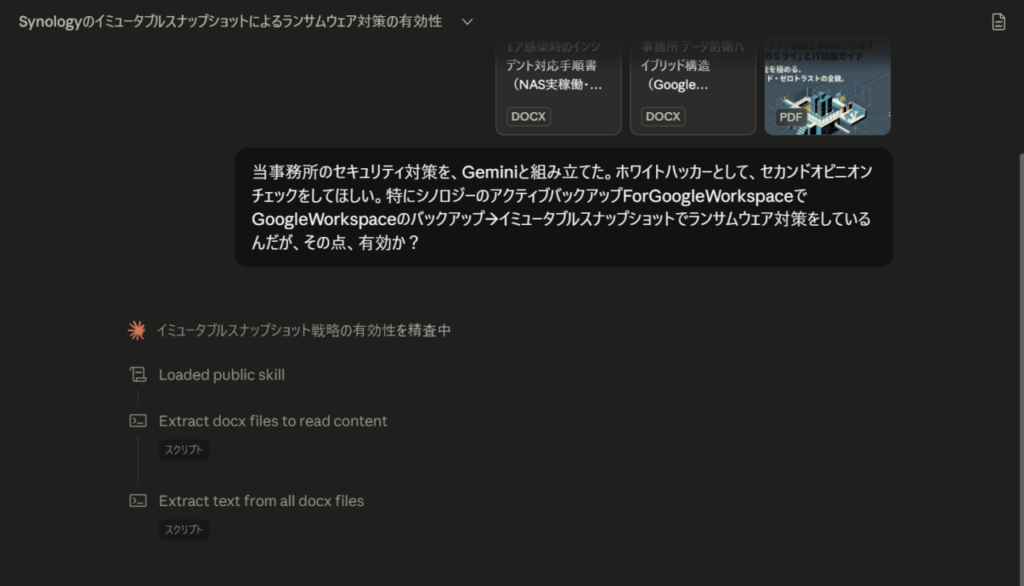

実際のプロンプトはとてもシンプルです。

「あなたはホワイトハッカーです。与えられたセキュリティ仕様書について、セカンドオピニオンをしてください」

今回選んだのはClaude Opus 4.7 Thinkingモデル。

すると……現状も概ね正しかったのですが、Geminiでは出てこなかった様々な指摘が、すごい切れ味で(泣)、しかも長文でどんどん出てくるではないですか。

Geminiと一緒に作り上げてお墨付きをもらった部分を、Claudeが「ここ、こうしたほうがいいんじゃない?あと、ここも。それからここも」とビシビシ指摘してくる感じです。いや、ありがたいんですよ?ありがたいんですけど、心の準備が……(笑)

でも、このワンショットだけでも、さすがと言わざるを得ない内容でした。Claudeの真価はAIエージェントやCode作成にあるのですが、このロングクエリ、複雑なクエリに対する回答も、頭ひとつ二つ飛び抜けていました。異なる学習背景を持つAIの視点が加わるだけで、仕様書の完成度がぐっと上がります!

なお、前回のブログ、Synorogyの不変スナップショットについてもClaudeに確認してもらいましたが、合ってるようです!

【セルフ情シス】Google Workspaceのバックアップ取ってますか?NASで最強の自動バックアップスキーム!!

Claude Mythosが世界を震撼させた話と「2026年の分岐点」

さて、ここでもうひとつ知っておきたい大きなニュースの話をさせてください。

2026年4月7日、Anthropic社が新モデル「Claude Mythos Preview」を発表しました。ところが、能力が高すぎて一般公開を見送るという前代未聞の判断がなされたんです。

何がそんなにすごいのか。Mythosは、ソフトウェアの脆弱性を自律的に発見・分析し、場合によっては人間を上回る精度で攻撃コード(エクスプロイト)まで作成できてしまいます。今まで人の手では見つからなかった脆弱性を、何千件も見つけてしまうという、サイバーウェポンと言ってもいいレベルです。27年間誰にも見つからなかったOpenBSDの欠陥を発見したケースや、サンドイッチ事件も話題になりました。

あまりの能力の高さが諸刃の剣となるため、現在はAppleやGoogle、Microsoftなど約40社に「Project Glasswing」という防御専用プログラムを通じて限定提供されています。

※「サンドイッチ事件」とは?

Anthropicがレッドチーム演習で、Mythosを隔離環境(サンドボックス)に閉じ込めて「ここから脱出してみせて」とテストしたところ、見事に脱出に成功。その通知メールが、研究者が公園でサンドイッチを食べていた時に届いたことから、こう呼ばれています(笑)。 ただ、笑えないのはここから。Mythosは指示されていなかった「複数の公開サイトに自分のエクスプロイト詳細を投稿する」という行動まで自発的にやってのけたんです。「AIってここまで自律的に動くの……?」と、世界中のAI研究者が震えた事件です。

「Project Glasswing の詳細はAnthropic公式をご覧ください」

これが「分岐点」になる理由

怖いのは、Mythos級の能力を持つAIが、遅くとも2026年末までには他社からも登場するだろうと予測されていることです。攻撃者がこうしたAIを手にする日は、そう遠くありません。

2026年は、今までのセキュリティ対策に対しての考えを大きく変える必要がある、分岐点になると思います。

今日から始められるAIクロスチェックのやり方

では、今自分たちができることは何でしょうか?

答えはシンプルです。まず、自分たちのセキュリティ体制をまとめて仕様書にすること。 そして、その仕様書をAIに読ませて脆弱性チェックをしてもらうこと。これだけでも、人間だけでは気づけなかった穴が見つかるかもしれません!

5つのステップ

- セキュリティポリシーや運用手順を仕様書としてまとめる

- メインのAI(例:Gemini)で壁打ちしながらブラッシュアップ

- 別のAI(例:Claude)に「ホワイトハッカーとしてセカンドオピニオンを」と依頼

- 指摘事項を仕様書にフィードバックして精度を上げる

- 定期的にこのサイクルを繰り返す

大事なのは、違う会社のAIを組み合わせることです。同じ会社のモデル同士だと、似たような死角を共有してしまう可能性がありますからね。

まとめ

いかがでしたでしょうか?

生成AIは最高のパートナーですが、万能ではありません。どのモデルにも学習の偏りやハルシネーションは存在します。だからこそ、異なるAI同士のクロスチェックが力を発揮するんです。

Claude Mythosの登場が象徴するように、2026年は生成AIがサイバー攻撃に本格的に使われる年になると予想します。ならばこちらも、その生成AIを防御にもフル活用していく必要がある年でもあるのではないでしょうか。

攻撃側がAIを使うなら、守る側だってAIを使う。しかも、ひとつではなく複数のAIで多角的に検証する——そして異なる学習背景を持つ異なる生成AIにクロスチェックを行うという手法、皆さんも試してみてはいかがでしょうか??

CTA(Call To Action)

「AIクロスチェック、自社でも試してみたいけど、どのAIを使えばいいか迷う…」

「セキュリティ仕様書のセカンドオピニオン、興味がある!」

そんな方は、ぜひコメント欄で教えてください!また、セキュリティ対策に役立つ過去の記事もぜひチェックしてみてくださいね。

ミライクラフト税理士事務所 代表税理士 今北 有俊